En el vertiginoso mundo digital actual, nos encontramos constantemente bombardeados por contenido que desafía nuestra percepción de la realidad. Desde vídeos de celebridades diciendo cosas que jamás dirían hasta imágenes impresionantes que parecen sacadas de un sueño, la línea entre lo auténtico y lo fabricado por Inteligencia Artificial se vuelve cada vez más difusa. 🤯

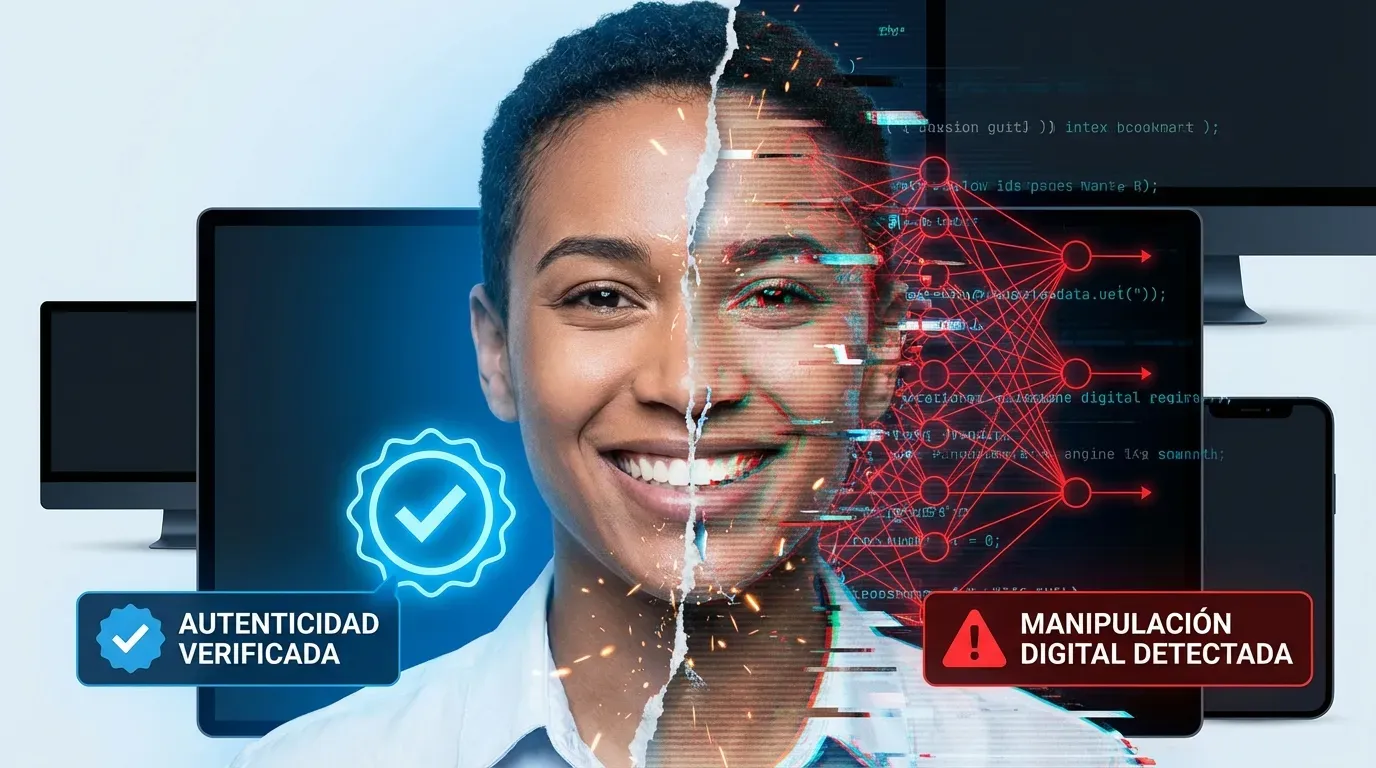

Esta proliferación de contenido manipulado, comúnmente conocido como «deepfakes», plantea serias amenazas a la confianza en noticias, procesos electorales, marcas y nuestras interacciones diarias. Ante esta realidad, surge una pregunta crucial: ¿cómo podemos saber qué es real y qué ha sido alterado?

Microsoft ha abordado esta inquietud con su reciente informe «Media Integrity and Authentication: Status, Directions, and Futures». Este estudio exhaustivo evalúa las herramientas de autenticación actuales, identifica sus limitaciones y propone caminos para fortalecerlas, capacitando a los usuarios para tomar decisiones informadas sobre el contenido que consumen. 🛡️

Los investigadores concluyen que no existe una solución única y mágica para combatir el engaño digital. Sin embargo, métodos como la proveniencia (rastrear el origen y la historia del contenido), las marcas de agua y las huellas digitales ofrecen pistas valiosas sobre quién creó el contenido, qué herramientas se usaron y si ha sido modificado. ✍️

Según Jessica Young, directora de política científica y tecnológica en la Oficina del Director Científico de Microsoft y coautora del estudio, el objetivo es crear un marco de «autenticación de alta confianza». Esto significa proporcionar información de procedencia más robusta y fiable para que el público pueda confiar en ella. La creciente sofisticación de los deepfakes y la inminente legislación sobre procedencia en varios países hacen que esta investigación sea más relevante que nunca. ⚖️

Microsoft ha estado a la vanguardia de esta lucha, siendo pionera en tecnologías de procedencia desde 2019 y cofundando la Coalition for Content Provenance and Authenticity (C2PA) en 2021. El estudio profundiza en:

- La necesidad de un enfoque multifacético: Ninguna tecnología por sí sola puede prevenir el engaño digital.

- Los ataques sociotécnicos: Cómo la información de procedencia o el propio medio pueden ser manipulados para engañar durante el proceso de validación. Un ejemplo claro es cómo una pequeña edición en una imagen puede hacer que los métodos de autenticación la califiquen erróneamente como generada por IA, desacreditando contenido real. 😲

- La durabilidad y fiabilidad de las credenciales de contenido: Investigar cómo mantener la información de procedencia segura y confiable a través de diferentes entornos, desde sistemas de alta seguridad hasta dispositivos offline menos seguros.

Verificar la autenticidad de los medios digitales es un desafío complejo debido a la diversidad de formatos (imágenes, audio, video, texto) y a las diferentes necesidades de transparencia de los usuarios y creadores. 🧐

A medida que el contenido generado o editado por IA se vuelve omnipresente, certificar la autenticidad del contenido original se vuelve crucial para editores, figuras públicas, gobiernos y empresas. La procedencia segura no solo ayuda a demostrar la fiabilidad, sino que también proporciona contexto, evitando que el público descarte información legítima como falsa. 💡

La investigación subraya la importancia de la investigación continua de usuarios y la colaboración entre la industria y los reguladores para garantizar que las herramientas de autenticación sean verdaderamente útiles y significativas en la práctica. No queremos que tecnologías valiosas fallen por ser malinterpretadas o mal utilizadas. 🤝

En NK, entendemos la importancia de la seguridad digital y la autenticidad de la información. Si tu empresa necesita fortalecer su presencia online, implementar soluciones de ciberseguridad robustas o desarrollar estrategias digitales fiables, no dudes en Contactarnos. ¡Podemos ayudarte a navegar el complejo panorama digital y asegurar tu información!